Historia del lenguaje, o de su evolución, o de la poesía, o de la literatura; la investigación de este perturbador proyecto ensayo, novela, crónica, guion, poemario, relatos, me ha puesto en volar la imaginación.

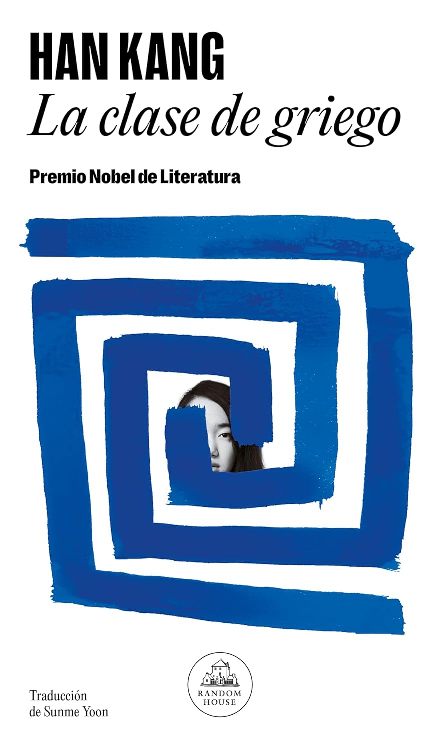

En el libro La clase de griego, Han Kang –ganadora reciente del premio Nobel de literatura–, hace referencias a Jorge Luis Borges. El primer párrafo comienza con la anécdota de la frase que le pidió a su esposa que hiciera grabar en su lápida: “Él tomó su espada y colocó el metal desnudo entre los dos.”, que pertenece a un poema épico nórdico. La interpretación que hace la autora de aquella elección tiene que ver con la sabida ceguera que afectó al escritor las últimas décadas de su vida.

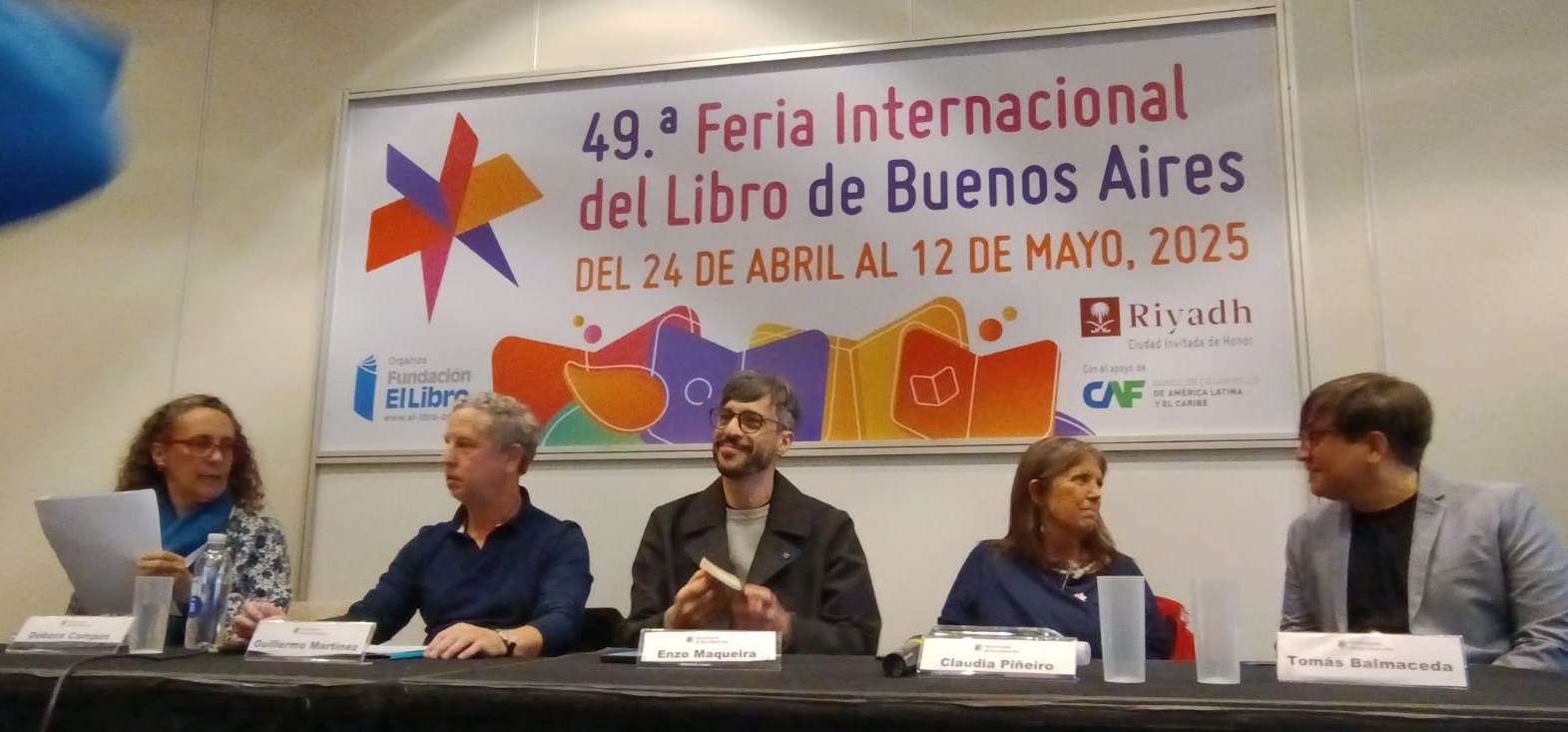

49 Feria Internacional del libro de Buenos Aires 2025

Curso sobre la Inteligencia Artificial: ¿Después de la IA, qué......? Segunda clase.

Participan: Enrique Díaz Cantón, Patricia Nigro y Alejandro Ditzend

Presenta: Nelly Espiño

Organiza: Fundación El Libro

Sala: Adolfo Bioy Casares

Pabellón: Pabellón Blanco

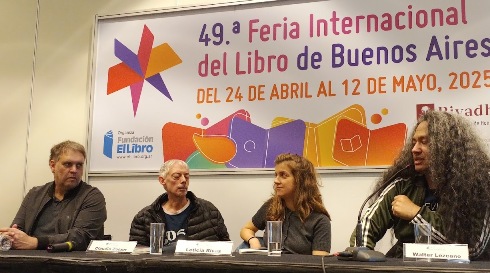

49 Feria Internacional del libro de Buenos Aires 2025

Autobiografía y autoficción. Cuatro escritoras argentinas contemporáneas abordarán en esta mesa sus experiencias en la narrativa que juega con la representación de la propia vida y la vida/memoria familiar, ya sea proponiendo un contrato autobiográfico más explícito, o deslizándose hacia la transfiguración imaginaria. Ambas modalidades florecen en un contexto social y cultural donde las "narrativas del yo" se mueven hacia el decidido primer plano.

Participan: Graciela Batticuore, María Rosa Lojo, Silvia Plager y Natalia Zito

Presenta: Fundación El Libro

Organiza: Fundación El Libro

Sala: Alejandra Pizarnik

Pabellón: Pabellón Amarillo

Curso sobre inteligencia artificial. ¿Qué es y qué no es la Inteligencia Artificial? Primera clase.

Participan: Patricio O´Gorman, Carlos Daneri y María Isabel Iñigo

Presenta: José Crettaz

Organiza: Fundación El Libro

Sala: Adolfo Bioy Casares

Pabellón: Pabellón Blanco. 14:30

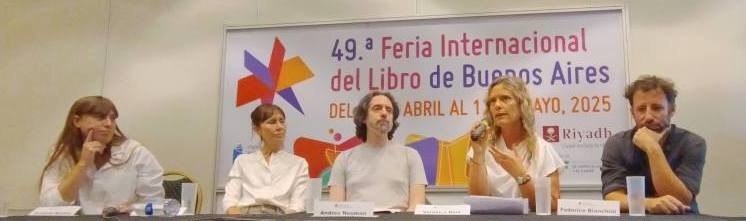

49 Feria Internacional del libro de Buenos Aires 2025

Diálogo de Escritoras y Escritores de Latinoamérica. Mesa VI. Escribir o reescribir la historia. Acontecimientos y personajes del pasado puestos bajo una nueva luz que los resignifica.

Participan: Alejandra Jaramillo (Col), Gabriela Cabezón Cámara (Arg), Diego Zúñiga (Chi), Andrés Neuman (Arg)

Presenta: Diego Erlan

Organiza: Fundación El Libro

Sala: Alfonsina Storni

Pabellón: Pabellón Blanco

El hogar no es un lugar, es una idea.

Elie Wiesel

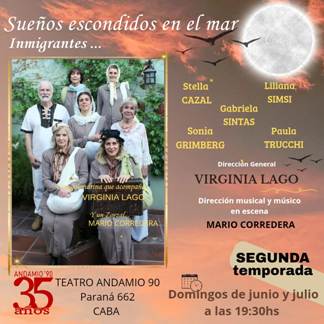

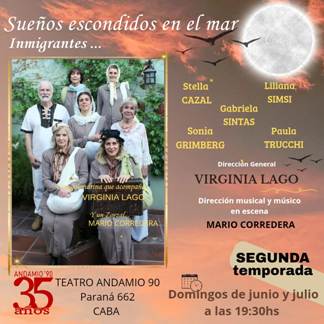

Todas la voces, todas. Representadas por estas mujeres que se trasladaron desde España, Italia, Paraguay, Armenia, Rumania hasta Buenos Aires.

Esta obra te abraza con amorosidad, humor, nostalgia, te acuna en la risa, en lo que fuimos y de dónde vinimos.

Bajo un manto de estrellas de Manuel Puig por Ana Abregú

“Una especie de solidaridad tácita une a los extraviados y a los solitarios”

“Una revolución en las costumbres” en Bye-Bye, Babilonia, crónicas de Nueva York, Londres y París.

En esta obra se siente “una especie de solidaridad entre extraviados”, “es exactamente como lo imaginé”, se dirá recursivamente en la obra. La frase describe el sino de la época: la educación sentimental provenía de escuchar la novela radial; el relato se reconfiguraba en el oyente, punto en común entre las clases: la pareja mayor, dueños de estancia; la pareja de misteriosos visitantes, adultos; y la niña de la casa, adoptada; revelan los sueños que nacieron en la era de las telenovelas y su influencia como parte de la penetración cultural que accionan el hecho constructivo del imaginario y los desvíos que propone el foco en la ilusión, en un ambiente endogámico que detona con diversas resonancias. El relato oído alimenta un romanticismo en el que cada personaje fantasea e imagina el objeto del deseo.

Las Bingueras de Eurípides de Ana López Segovia por Ana Abregú

Suerte, risas y mucho bingo. ¡Prepárense para gritar '¡Bingo!'! La emoción del dabber.

[Lema popular]

Divertida propuesta que remite a diversos estilos teatrales, así como referentes eclécticos.

Dionisia –Mar Bell Vazquez–, mito griego, baja a la tierra; y como el primigenio, se aboca a remover la estructura social conmoviendo la forma tradicional de subyugación de mujeres. Dionisio toma cuerpo de mujer para acompañar el proceso de empoderamiento. Eco entre formatos que se extienden entre géneros de humor basado en la expresividad corporal y diálogo punzante.

(Foto tomada de Internet)

No te pierdas ésto

Gotas

Revista Metaliteratura

Revista Metaliteratura